Hướng dẫn này trình bày cách sử dụng tác nhân (agent) Gemini Deep Research mới thông qua Interactions API để thực hiện các tác vụ nghiên cứu phức tạp, tạo hình ảnh dựa trên các phát hiện và dịch kết quả.

- Bản xem trước: Gemini Deep Research Agent hiện đang trong giai đoạn xem trước (preview).

- Tác nhân Deep Research chỉ có thể truy cập duy nhất thông qua Interactions API. Bạn không thể sử dụng nó thông qua phương thức generate_content thông thường.

!uv pip install google-genai --upgrade

import time from google import genai from IPython.display import display, Markdown client = genai.Client()

1. Tác vụ nghiên cứu cơ bản (Sử dụng cơ chế Polling)

Ví dụ dưới đây cho thấy cách bắt đầu một tác vụ nghiên cứu ở chế độ chạy nền (background) và kiểm tra định kỳ (poll) để lấy kết quả. Đây là cách tiêu chuẩn để tương tác với tác nhân Deep Research.

prompt = "Nghiên cứu lịch sử của Google TPUs." interaction = client.interactions.create( agent='deep-research-pro-preview-12-2025', input=prompt, background=True ) print(f"Bắt đầu nghiên cứu: {interaction.id}") # Kiểm tra định kỳ để lấy kết quả while True: interaction = client.interactions.get(interaction.id) if interaction.status == "completed": print(f"Nghiên cứu hoàn tất: {interaction.id}") break elif interaction.status == "failed": print(f"Nghiên cứu thất bại: {interaction.error}") break print(".", end="", flush=True) time.sleep(10) display(Markdown(interaction.outputs[-1].text))

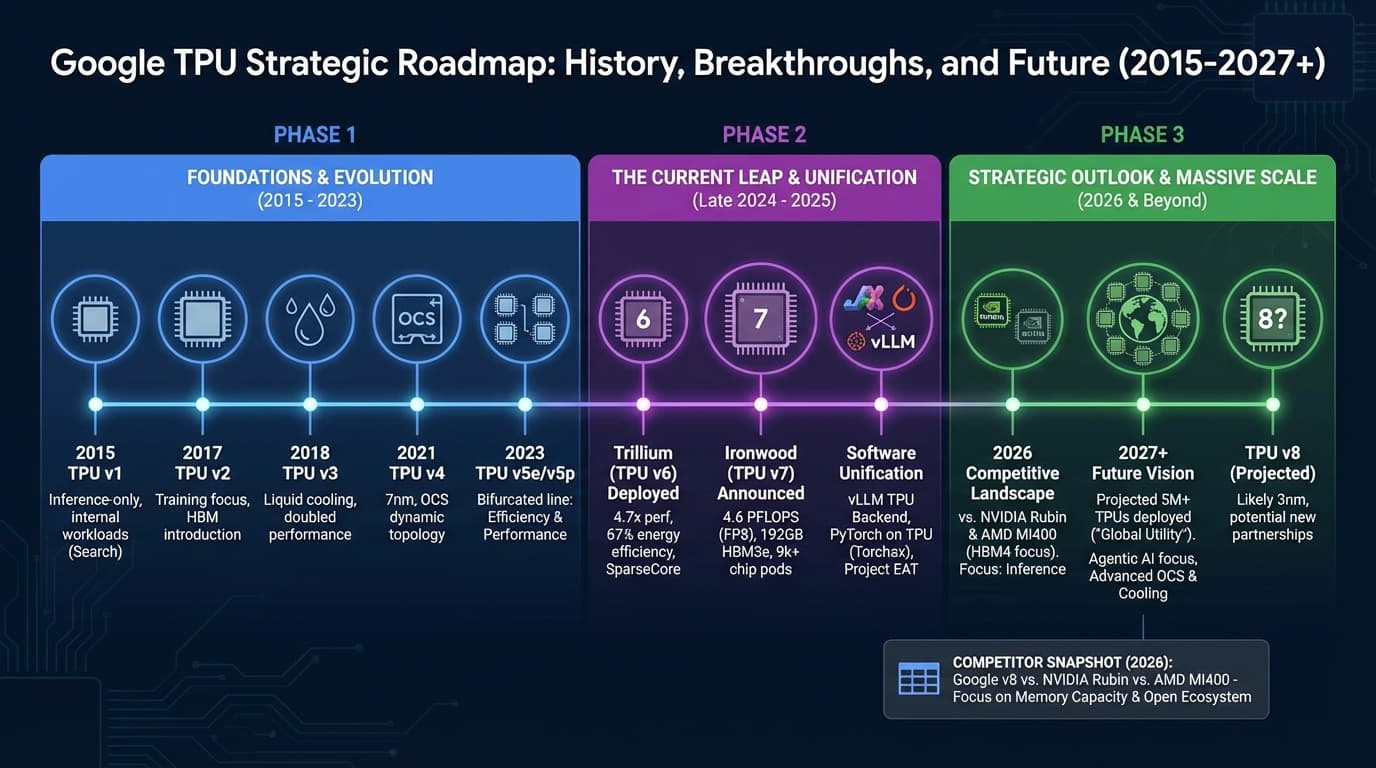

Sự phát triển của Google Tensor Processing Units: Phân tích Lịch sử và Kiến trúc

Các điểm chính

- Nguồn gốc từ nhu cầu thực tế: Dự án Tensor Processing Unit (TPU) được khởi động vào năm 2013 khi các kỹ sư Google nhận ra rằng cơ sở hạ tầng CPU và GPU hiện tại không thể đáp ứng nhu cầu tính toán của các ứng dụng học sâu và tìm kiếm bằng giọng nói đang phổ biến nếu không tăng gấp đôi diện tích trung tâm dữ liệu.

- Sự chuyển dịch mô hình kiến trúc: Khác với kiến trúc Von Neumann của CPU, TPU sử dụng kiến trúc mảng tâm trương (systolic array). Thiết kế này mô phỏng dòng chảy của máu qua tim, cho phép dữ liệu chảy qua hàng nghìn đơn vị logic số học (ALU) mà không cần truy cập bộ nhớ cho các kết quả trung gian, giúp tăng đáng kể hiệu quả cho các phép nhân ma trận.

2. Tác vụ nghiên cứu nâng cao (Streaming, Thinking, Prompting)

Deep Research hỗ trợ truyền dữ liệu (streaming) để nhận các cập nhật theo thời gian thực về tiến trình nghiên cứu (thông qua thinking_summaries). Bạn có thể điều hướng kết quả đầu ra của tác nhân bằng cách cung cấp các hướng dẫn câu lệnh (prompt) cụ thể.

# Định nghĩa một câu lệnh phức tạp với các hướng dẫn định dạng prompt = """ Nghiên cứu lịch sử và các bước phát triển trong tương lai của Google TPU. Tập trung vào: 1. Các đột phá công nghệ quan trọng trong 12 tháng qua. 2. Các đối thủ cạnh tranh lớn và lộ trình dự kiến của họ để sản xuất hàng loạt. 3. Các phát triển và kế hoạch tương lai cho năm 2026 và xa hơn nữa. Định dạng đầu ra: - Dưới dạng một tài liệu tóm tắt chiến lược dành cho nhà phát triển đang tìm hiểu về hệ sinh thái Google TPU. - Bao gồm một bảng so sánh 3 công ty dẫn đầu hàng đầu. - Sử dụng các câu ngắn gọn, súc tích và các dấu đầu dòng. """ stream = client.interactions.create( agent="deep-research-pro-preview-12-2025", input=prompt, background=True, stream=True, agent_config={ "type": "deep-research", "thinking_summaries": "auto" } ) interaction_id = None last_event_id = None report = "" for chunk in stream: if chunk.event_type == "interaction.start": interaction_id = chunk.interaction.id print(f"Bắt đầu tương tác: {interaction_id}") if chunk.event_id: last_event_id = chunk.event_id if chunk.event_type == "content.delta": if chunk.delta.type == "text": report += chunk.delta.text elif chunk.delta.type == "thought_summary": # Hiển thị tóm tắt suy nghĩ của AI khi đang nghiên cứu print(f"{chunk.delta.content.text}n", flush=True) elif chunk.event_type == "interaction.complete": print("nNghiên cứu hoàn tất") prev_ia = client.interactions.get(interaction_id) display(Markdown(report))

3. Kết hợp tương tác Deep Research với tương tác Mô hình

Interactions API hỗ trợ các tương tác có trạng thái (stateful), cho phép bạn tiếp tục cuộc hội thoại sau khi tác nhân trả về báo cáo cuối cùng bằng cách sử dụng previous_interaction_id.

Bạn có thể tiếp tục cuộc hội thoại này bằng cách sử dụng một mô hình khác để trực quan hóa kết quả (dùng Nano Banana Pro) hoặc dịch kết quả (dùng Gemini Flash).

import base64 from IPython.display import Image print("Đang tạo hình ảnh...") image_interaction = client.interactions.create( model="gemini-3-pro-image-preview", input="Trực quan hóa báo cáo trên thành một slide dòng thời gian (timeline)", previous_interaction_id=interaction_id, ) image_data_list = [data for data in image_interaction.outputs if data.type == "image"] for output in image_data_list: image_bytes = base64.b64decode(output.data) display(Image(data=image_bytes))

print("Đang dịch...") translate_interaction = client.interactions.create( model="gemini-3-flash-preview", input="Dịch báo cáo trên sang tiếng Đức đơn giản.", previous_interaction_id=interaction_id, ) display(Markdown(translate_interaction.outputs[-1].text))

Báo cáo chiến lược: Hệ sinh thái Google TPU

Google đang đẩy nhanh việc phát triển các chip AI tự thiết kế (TPU) để thách thức NVIDIA. Trong 12 tháng qua, các dòng chip Trillium (v6) và Ironwood (v7) đã mang lại những bước tiến lớn. Mọi thứ đang trở nên dễ dàng hơn đối với các nhà phát triển: Nhờ các công cụ phần mềm mới, các mô hình PyTorch giờ đây có thể chạy trên TPU mà hầu như không cần thay đổi gì. Đến năm 2027, Google đặt mục tiêu đưa hơn 5 triệu TPU vào sử dụng.

Nguồn bài viết từ Tác giả Phil Schmid